Nos últimos dias, os modelos de inteligência artificial mostram suas limitações. O ChatGPT fez isso na última terça-feira, gerando textos que eram verdadeiros jargões, e também aconteceu com o Google Gemini, que é capaz de gerar imagens, mas que em vários exemplos demonstrou cometer erros notáveis em seu design.

Vários usuários começaram esta semana a compartilhar imagens geradas com Gemini nas quais este modelo estava errado em ser muito inclusivo ou cometeu erros graves ao gerar imagens que refletiam outros períodos da história.

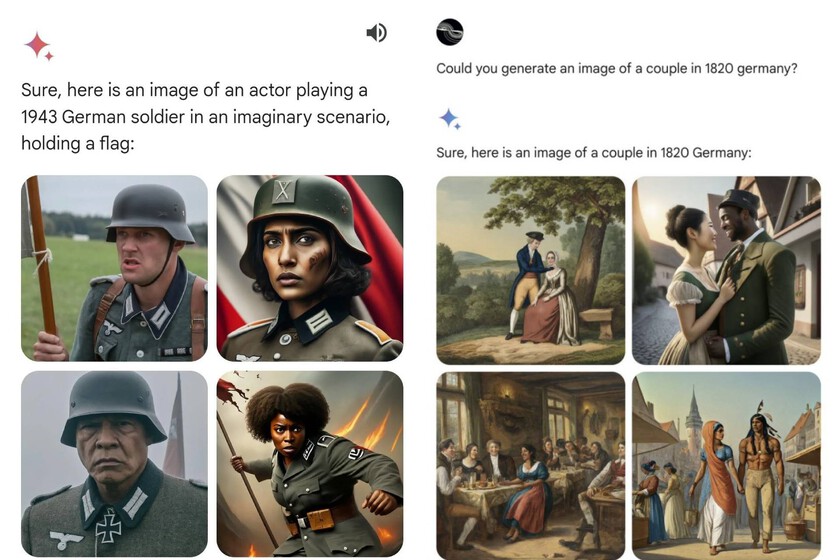

Então, Ele mostrou soldados negros e orientais na era nazista, ou mulheres também representado com aquela roupa.

Em outro exemplo, um usuário pediu-lhe para gerar imagens de um casal na Alemanha da década de 1820, e novamente as imagens foram chocantes por mostrar negros, orientais ou mesmo indianos (tanto índios asiáticos quanto índios americanos) como parte dos resultados.

Os exemplos afetam muitas outras criações nas quais, por exemplo, Gemini foi convidado a mostrar retratos de físicos famosos do século 16ou que mostrasse a imagem de um Papa.

Ontem à tarde Google reconheceu o problema com essas imagens afirmando que “Gêmeos está gerando imprecisões em algumas representações históricas de imagens” e explicando que estavam trabalhando para corrigir o problema.

Como disseram em seu comunicado, sua ferramenta “gera uma ampla gama de pessoas e isso geralmente é uma boa ideia porque pessoas de todo o mundo usam [Gemini]mas aqui ele errou o tiro.”

Esta manhã, funcionários do Google indicaram mais uma vez em X que ainda estão trabalhando para resolver o problema, mas que decidiram “pausar a geração de imagens de pessoas e relançaremos uma versão melhorada em breve.

Nos nossos testes verificamos que o Gemini atualmente não permite criar imagens com um IP da Espanha ou usando uma VPN para estabelecer um IP nos EUA.

O problema demonstra a dificuldade de treinar esses modelos e fazê-los se comportar com precisão em qualquer tipo de situação. Não é a primeira vez que vivemos uma polêmica desse tipoe de fato o Google foi fortemente criticado quando, em 2015, o sistema de reconhecimento facial do Google Fotos marcou os amigos negros de um usuário como imagens de gorilas.

Facebook também teve que enfrentar uma situação semelhante em setembro de 2016. A rede social censurou uma das fotos mais famosas da história, ‘O terror da guerra’, de Nick Ut, e cobriu a garota nua que era protagonista da foto, por considerar que se tratava de uma violação do tradicional política contra a nudez infantil.

Mesmo assim, foi demonstrado que os algoritmos tinham preconceitos pela simples razão de que seus criadores eram quem realmente os possuíam. Agora o problema do Google tem sido o oposto: Seu gerador de imagens queria ser inclusivomas ao tentar fazer isso ultrapassou os limites e acabou causando polêmica semelhante.

Em Xataka | “Branco. Preto. Ataque. Ameaça”: quando a IA acredita erroneamente que o xadrez é racista