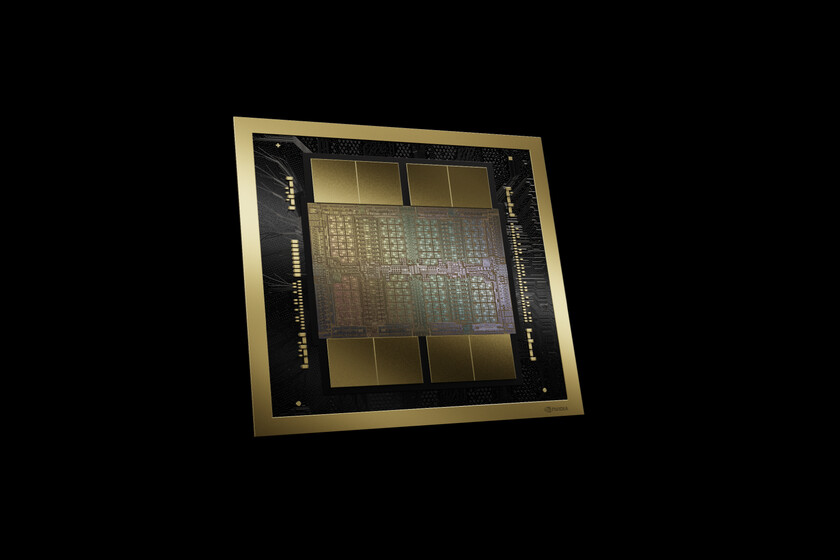

A NVIDIA não está disposta a ceder terreno no crescente mercado de inteligência artificial. Rivais como Cerebras e Rebellions começam a surgir mas a empresa liderada por Jensen Huang tem uma nova proposta para os seus clientes mais ambiciosos: acaba de apresentar uma nova arquitectura de alto desempenho denominada Blackwell que se materializa em dois novos chips o B200 e GB200.

Nos últimos anos temos testemunhado a evolução da empresa americana. Em 2020 assistimos ao lançamento dos chips A100, que chegaram com 54 bilhões de transistores, em 2022 chegou o H100, dessa vez com 80 bilhões de transistores. E agora, com um H200 que ainda não está disponível, a fabricante acaba de anunciar o salto para 208 bilhões de transistores.

B200, o novo chip NVIDIA com um monte de transistores

Nas operações FP4, o novo chip B200 da NVIDIA promete entregar até 18 petaFLOPS de desempenho em uma configuração HGX ou DGX refrigerada a ar. No entanto, os clientes empresariais que desejam obter um extra podem fazê-lo equipando os seus centros de dados com refrigeração líquida. Atendendo a esse requisito, o chip poderá atingir 20 petaFLOPS de desempenho.

Ao nível da memória, o B200 tem largura de banda de 8 TB/s e suporta até 192 GB de VRAM. Estamos diante de um chip com arquitetura Blackwell que, segundo seu fabricante, pode reduzir o consumo de energia em até 25 vezes em comparação ao H100. Quando falamos sobre o chip H100, estamos nos referindo ao produto de sucesso da arquitetura Hopper encontrado, por exemplo, nos data centers Azure AI da Microsoft.

Superpod DGX

A NVIDIA também anunciou o chip GB200. Neste caso estamos olhando para uma solução que combina uma CPU Grace de 72 núcleos com duas GPUs B200 para atingir um desempenho teórico máximo de 40 petaFLOPS nas operações FP4 e aumentar a quantidade de memória HBM3e para 384 GB. A essência deste “superchip” é suportada pelo sistema de interconexão de alta velocidade NVLink-C2C.

Em plena ascensão da inteligência artificial, este tipo de soluções de hardware tornou-se essencial para o treinamento de modelos de linguagem. Hoje temos à disposição modelos como GPT-4 da OpenAI ou Claude 3 da Anthropic, que foram treinados com equipamentos menos potentes e menos eficientes. A nova geração de hardware pode ajudar a acelerar modelos que estão a caminho e que ainda não vimos.

Quando as GPUs são implantadas em seus data centers, elas ficam localizadas em racks enormes. Uma configuração DGX com 18 nós GB200 pode suportar modelos de até 27 bilhões de parâmetros. No nível de desempenho, isso se traduz em mais de 1 exaFLOP de desempenho. Uma verdadeira loucura se levarmos em conta que o primeiro sistema DGX que a NVIDIA entregou à OpenAI atingiu no máximo 0,17 petaFLOPS.

Imagens | NVIDIA

Em Xataka | A Supermicro é a gigante escondida na era da IA. Está crescendo mais que a NVIDIA