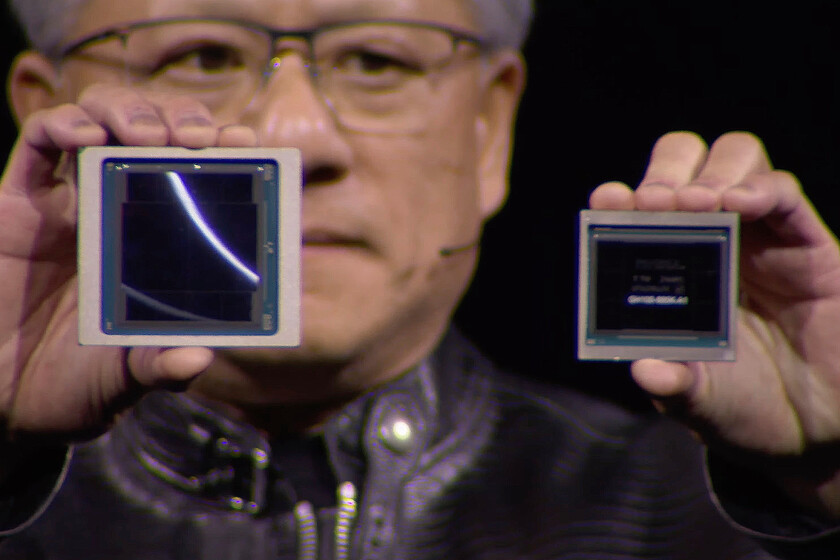

Jensen Huang estava no seu elemento ontem. Sabendo que hoje os rivais ainda estão tentando ganhar terreno, ele apresentou – entre outras coisas – seus novos chips de inteligência artificial B200 da arquitetura Blackwell.

Esses monstros da computação dão um claro salto quantitativo: dos 80 bilhões de transistores do prestigiado H100 com arquitetura Hopper, agora passam para 208 bilhões de transistores. Isso os torna 2,5 vezes mais poderosos que seus antecessores e certamente os tornará produtos altamente procurados nesta era da IA onde a capacidade de processamento faz a diferença.

O evento GTC 2024 da NVIDIA trouxe outras novidades importantes, como o gêmeo digital do nosso planeta, a Terra-2, para analisar a meteorologia, seu Projeto GROOT para robôs humanóides ou sua nova plataforma de simulação quântica.

Tudo uma confirmação promissora e clara de que a empresa quer aproveitar sua atual inércia para continuar dominando em data centers dos quais dependemos para uma infinidade de processos, tanto profissionais como cotidianos. Mas a NVIDIA aparentemente está esquecendo algo.

Os usuários.

Na verdade, é especialmente chocante que não tenha havido notícias relacionadas à outra vertente da inteligência artificial que está gradualmente emergindo: a capacidade de executar aplicações de IA localmente.

Começamos a ver onde as coisas podem chegar nestes primeiros meses de 2024. Os fabricantes de PCs, laptops e dispositivos móveis estão aproveitando – talvez excessivamente – a IA como argumento para nos vender seus novos dispositivos. Embora por enquanto as abordagens sejam interessantes mas relativamente modestas – transcrever conversas, traduzi-las em tempo real, fazer resumos – tudo indica que essas características irão mais longe.

Mas para isso seria importante contar com chips especializados. Assim como temos placas gráficas para jogos, é razoável pensar que as placas aceleradoras de IA seriam úteis para este tipo de aplicações. É verdade que os atuais SoCs da Apple, Intel, AMD ou Qualcomm integram núcleos dedicados (normalmente conhecidos como NPUs, Neural Processing Units), mas têm que compartilhar espaço com os demais componentes, e em alguns casos isso pode não ser suficiente.

Esse nó de computação Blackwell possui duas CPUs Grace e quatro das novas GPUs B200 com arquitetura Blackwell. Seu desempenho e IA podem chegar a 80 petaFLOPS segundo a empresa. Uma indignação absoluta.

E há a NVIDIA, que tem uma magnífica oportunidade de se tornar essencial em PCs, laptops, tablets e smartphones – e praticamente em qualquer outro dispositivo – e parece não ter nenhuma solução nesse sentido. É verdade que seus gráficos RTX também servem para agilizar esse tipo de processo, mas não foram projetados especificamente para isso. E é aí que reside o ponto crucial – aliás, pronunciado [kíd] e não [kuíd] – da pergunta.

Essa lebre em particular foi levantada meses atrás pela Groq – não deve ser confundida com a Grok – uma startup que projetou com precisão chips de IA chamados LPUs e se especializou em processamento de linguagem. Ou o que é o mesmo: Aceleradores ChatGPT.

Sua proposta é mais marcante, sobretudo porque abre as portas para essa nova tendência que significaria que não teríamos apenas uma CPU ou GPU em nosso computador ou smartphone, mas também uma LPU para que a interação com chatbots como ChatGPT, Copilot ou Gêmeos seja especialmente rápida.

Mas a NVIDIA não parece interessada nesse setor no momento. Em parte é compreensível: a empresa está voando alto graças a chips como o H100, e é previsível que continue assim com o novo B200. E, no entanto, ninguém está melhor posicionado do que eles para propor soluções desse tipo.

Talvez eles tenham más lembranças de sua aventura anterior em um mundo que não era o das placas gráficas. Os chips NVIDIA Tegra eram SoCs como os feitos agora pela Qualcomm, Apple ou MediaTek: tinham CPU e GPU ARM e estavam focados no processamento multimídia eficiente.

Eles não se saíram muito mal com o experimento: o Tegra

Desde então, porém, não houve melhorias ou desenvolvimentos aparentes exceto pelo fato de que em 2021 se falava que iriam parar de produzi-los, mas aparentemente acabaram reintroduzindo sua fabricação devido ao lançamento dos Switch OLEDs, também baseados nas fichas.Tegra. Eles venderam milhões de chips graças ao sucesso desses consoles, então… por que não fortalecer essa linha de produtos?

Só a NVIDIA sabe. A verdade é que seu claro foco no segmento de placas gráficas dedicadas e agora em chips de IA parece descartar a possibilidade de chips aceleradores de IA serem planejados para nossos celulares ou computadores. Será uma questão de tempo sei se isso foi um erro mas a priori parece um campo interessante no qual a empresa poderia ter lançado sua proposta.

Em Xataka | A Supermicro é a gigante escondida na era da IA. Está crescendo mais que a NVIDIA