Os chatbots se tornaram um dos pilares da ascensão da inteligência artificial (IA). Do ChatGPT e Copilot ao Claude Chat e Perplexity, essas ferramentas estão em alta. No entanto, por mais animados que fiquemos, não devemos confiar totalmente em suas respostas.

E diga isso ao advogado que usou o ChatGPT para ganhar um julgamento e descobriu que os documentos apresentados ao juiz continham decisões judiciais, referências e citações falsas. Como podemos ver, os chatbots têm muitas virtudes, mas a confiabilidade não é uma delas.

Uma possível solução para o problema de confiabilidade

Um estudo publicado por uma startup fundada por ex-funcionários do Google sugere que os chatbots têm uma taxa de alucinações de pelo menos 3%. Para muitos usuários isso pode ser um problema menor, mas as coisas mudam quando falamos de usos profissionais.

Ferramentas alimentadas por grandes modelos de linguagem (LLM) estão chegando ao mundo dos negócios através de soluções como o Copilot no Office 365. Agora, se os funcionários acabarem lidando com informações erradas, isso pode acabar causando mais de uma dor de cabeça para a empresa.

Cleanlab, startup fundada por ex-pesquisadores do MIT, acaba de lançar sua própria iniciativa para resolver esse problema. Estamos falando de uma ferramenta alimentada pelo que chamam de Trustworthy Language Model (TLM), uma abordagem que visa confiabilidade das respostas.

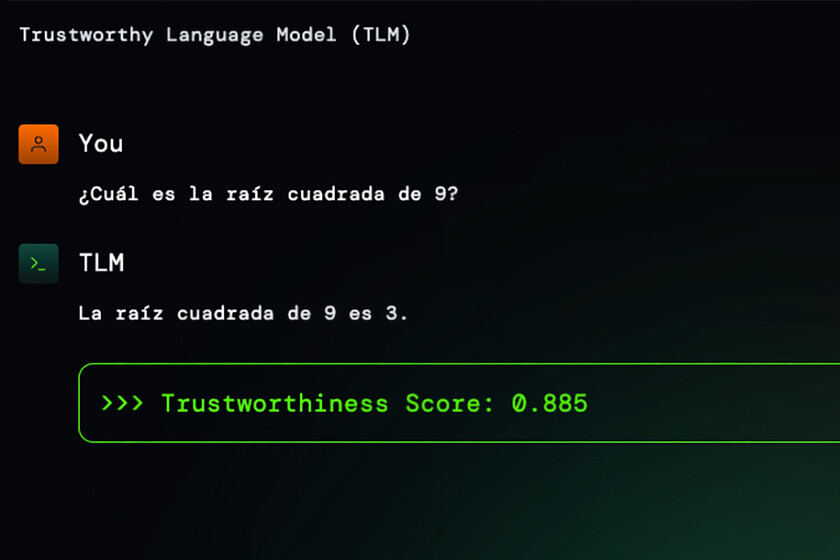

O TLM funciona como uma “camada de confiança” para que os usuários possam saber o quão confiável é a resposta que acabaram de receber por meio de um sistema de pontuação. Esta ferramenta foi projetada para funcionar de forma complementar a modelos como GPT-3.5, GPT-4 e modelos personalizados de empresa.

O sistema envia nossa pergunta para diversos modelos e depois analisa seu retorno. A resposta virá acompanhada de uma pontuação que ficará entre 0 e 1. Em um teste simples em que perguntamos a raiz quadrada de nove obtivemos a resposta correta (3) com pontuação de 0,885.

Cleanlab ressalta que o ChatGPT em sua versão gratuita pode errar em coisas muito simples. Quando questionado sobre quantas vezes a letra “N” aparece na palavra “enter”, o chatbot OpenAI geralmente responde que a letra aparece duas vezes. Nós testamos e de fato o chatbot responde incorretamente.

A startup imagina que sua tecnologia será útil em uma ampla gama de usos. Eles mencionam que isso poderia ajudar chatbots de atendimento ao cliente para ser mais confiável. O chatbot funcionaria automaticamente, mas se uma das respostas ficar abaixo do limite de confiabilidade, poderá ser solicitada a intervenção humana.

Se você é um entusiasta da inteligência artificial, pode experimentar o TLM pela web. A ferramenta também está disponível por meio de uma API. Ressalta-se que a solução está disponível em versões gratuitas de código aberto e versões pagas com recursos adicionais.

Imagens | Laboratório limpo | Captura de tela

Em Xataka | O vencedor mais inesperado da primeira grande batalha pela IA é também aquele que pensávamos estar morto: Meta